人工智能学院杨溪老师研究成果被计算机图形学顶级会议SIGGRAPH ASIA 2025接收。杨溪老师为通讯作者,该工作与日本中京大学Ran Dong老师及日本三重大学Shaowen Ni老师合作完成。

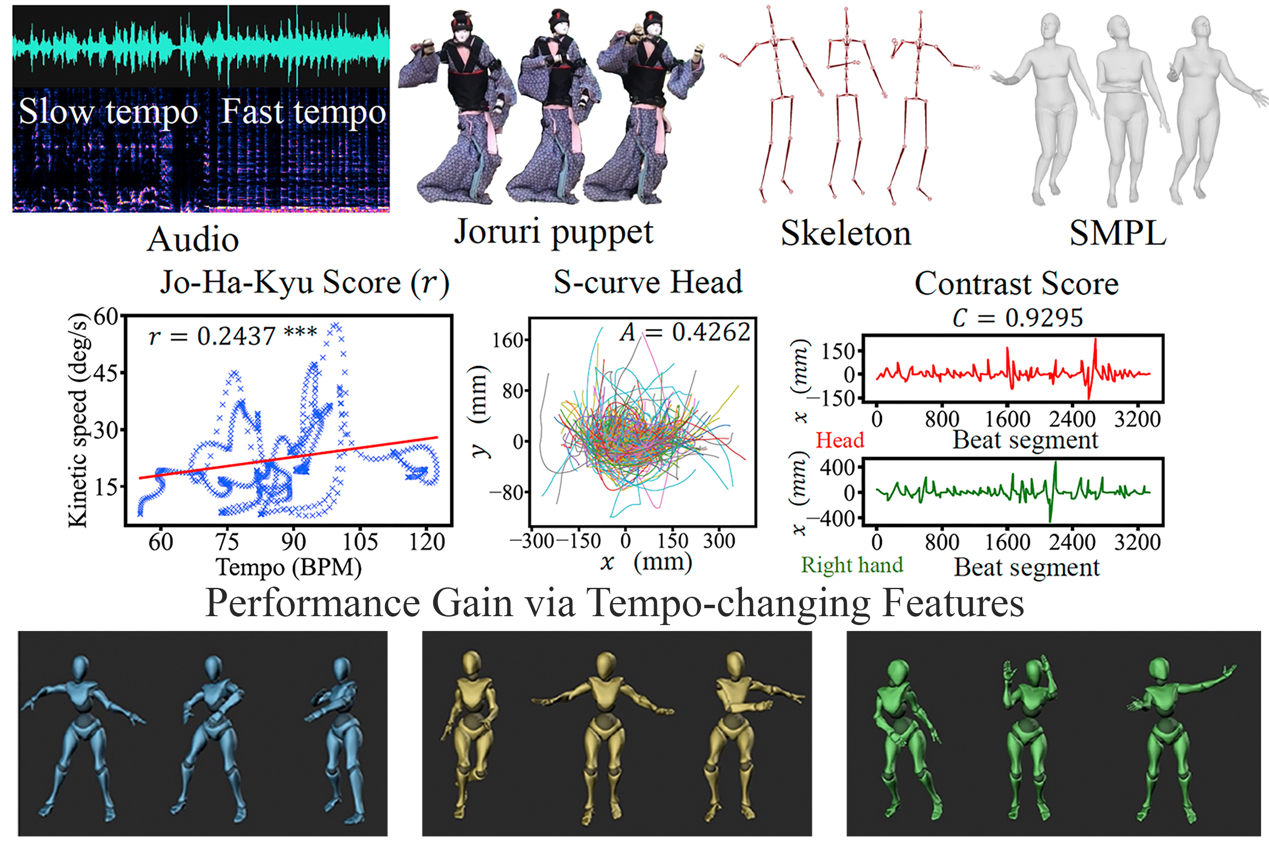

论文题目:JoruriPuppet: Learning Tempo-Changing Mechanisms Beyond the Beat for Music-to-Motion Generation with Expressive Metrics

通讯作者:杨溪

会议名称:SIGGRAPH ASIA 2025

成果简介:

音乐转动作生成中,动作与音乐节奏变化之间的互动对表演的情感表现力和真实感具有重要影响。然而,由于相关数据集的匮乏,基于神经网络的音乐转动作任务中针对节奏变化机制的研究仍然不足。为此,本文提出一种能够显式表示节奏变化的新型音乐特征,并引入日本非物质文化遗产戏剧数据集(JoruriPuppet),该数据集融合了以富有表现力的节奏变化为核心的日本传统律动原理。此外,我们设计了三项指标,用于定量评估生成动作的同步性与表现力。在该数据集上的实验结果表明,现有SOTA方法在捕捉细粒度节奏变化方面存在局限性。进一步,我们验证了将节奏变化特征引入模型能够显著提升基于神经网络的音乐转动作生成在现有数据集上的性能,从而证明了本研究的普适性。