人工智能学院2024级博士研究生杨哲健的论文《TGSBM: Transformer-Guided Stochastic Block Model for Link Prediction》被CCF-A类会议WWW 2026接收。WWW(The Web Conference)是互联网和万维网技术领域最具影响力的会议之一,每年吸引全球范围内的学者、研究人员、行业专家和从业者,分享和讨论最新的研究成果、技术和应用。WWW 2026 将于 2026年4月13日至4月17日于阿联酋迪拜举行。

论文题目:TGSBM: Transformer-Guided Stochastic Block Model for Link Prediction

第一作者:杨哲健 (2024级博士)

指导教师:陈贺昌

收录会议:WWW 2026 (CCF-A)

论文概述:

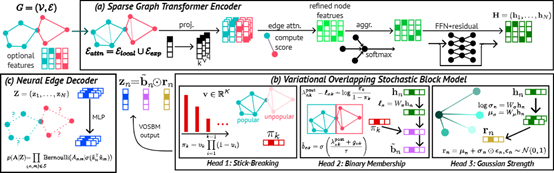

链接预测作为网络分析中的关键技术,在推荐系统、搜索引擎、知识图谱补全以及协同预测等众多应用中发挥着核心作用。然而,大规模网络所呈现出的独特特性——包括数十万乃至百万级的节点与边、随时间动态演化的异质性结构,以及重叠且非互斥的社区组织——对现有方法提出了严峻挑战。传统图神经网络(GNNs)在建模长程依赖和全局结构方面存在固有局限;而近期兴起的图Transformer虽在性能上取得显著进展,却往往伴随二次时间复杂度,难以扩展至大规模图,并且其黑箱性质削弱了对潜在社区结构的可解释性。针对上述问题,本文提出一种Transformer引导的随机块模型(Transformer-Guided Stochastic Block Model, TGSBM)。该框架有机融合了重叠随机块模型(Overlapping Stochastic Block Model, OSBM)的生成式结构优势与稀疏图Transformer的强表达能力。TGSBM由三个关键组件构成:1)一种扩展增强的稀疏注意力机制,在保留全局信息传播能力的同时,将计算复杂度降至近线性级别;2)一个神经变分编码器,用于推断每个节点在多个社区中的成员身份及其隶属强度,从而学习结构化的后验分布;3)一个基于OSBM先验的神经边解码器,通过显式的生成过程重构图中的链接,确保模型不仅具备预测能力,还保持对社区结构的可解释性。我们在多个标准基准数据集上进行了系统实验,结果表明:TGSBM在链接预测任务中展现出与当前先进方法相当甚至更优的性能,同时具备卓越的可扩展性与清晰的社区语义解释能力。综上所述,TGSBM为大规模动态网络中的链接预测提供了一种兼顾准确性、计算效率与模型透明度的实用化解决方案。